Arrêtez d’anthropomorphiser les lignes de code.

Elon Musk a promis que sa société de médias sociaux X serait « l’application de tout », mais de nos jours, « tout » semble n’inclure que les slops, la propagande fasciste et les abus. De plus en plus, le site de médias sociaux regorge d’images sexuelles vulgaires et non consensuelles que les utilisateurs créent avec l’outil d’IA intégré de X, Grok. Comme Le Gardien Nick Robins-Early a écrit :

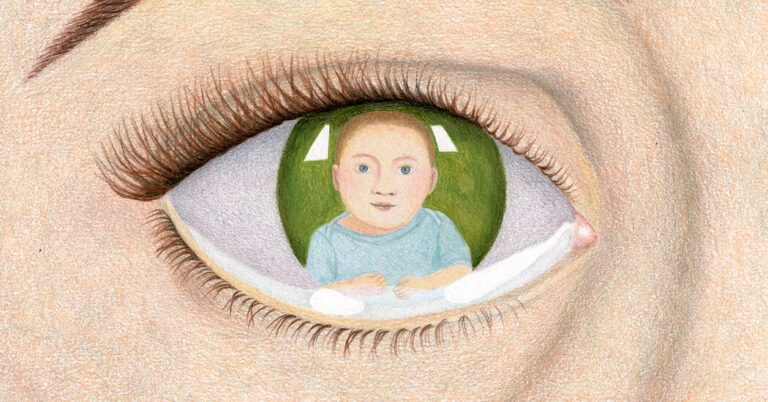

De nombreux utilisateurs de X ont incité Grok à générer ces derniers jours des versions sexualisées et non consensuelles d’images modifiées par l’IA, enlevant dans certains cas les vêtements des personnes sans leur consentement. Musk a republié jeudi une photo IA de lui-même en bikini, sous-titrée avec des émojis rieurs, en clin d’œil à la tendance.

Et comme 404 Media l’a découvert, les abus permis par ce logiciel sont probablement bien pires qu’il n’y paraît et ne constituent à bien des égards que la dernière escalade d’un problème de fluage en ligne aussi vieux qu’Internet.

C’est horrible, de haut en bas, en particulier pour les femmes qui sont agressivement ciblées par les utilisateurs de X simplement pour leur présence en ligne.

L’écrivain Ketan Joshi a relevé un étrange schéma de langage et d’usage dans la couverture médiatique de ce scandale. Joshi a publié un fil de discussion sur Bluesky rassemblant des exemples « de grands médias anthropomorphisant faussement le programme de chatbot « Grok » et, ce faisant, supprimant activement et directement la responsabilité des personnes travaillant chez X qui ont créé un générateur de pédopornographie. Les exemples de titres et d’articles que Joshi a trouvés incluent des expressions telles que « Grok s’excuse », « Grok dit » ou « Le chatbot IA d’Elon Musk blâme ». Les articles vont plus loin dans certains cas, en citant l’agence de logiciels comme « écrire », « dire » et « publier ».

Le problème ici, comme l’a écrit Joshi, est que ce cadrage détourne la responsabilité des personnes qui utilisent et mettent en place ce logiciel. Impliquer que le chatbot et le programme de génération d’images lui-même sont responsables permet aux gens de se cacher de leur propre culpabilité dans l’ombre du bot.

C’est une tendance dans la manière dont l’IA est discutée depuis un certain temps. Le langage et le cadrage des médias sont souvent trop respectueux du battage marketing de l’industrie technologique – imaginez blâmer un grille-pain pour une tranche de multigrains brûlée simplement parce qu’un vendeur vous a assuré qu’il s’agissait du capteur intelligent Bread Safe. technologie. Cette tendance à supposer que ces programmes sont aussi performants qu’on nous le dit n’est pas propre à l’IA – pensez aux « bombes intelligentes » – mais la tendance en matière d’utilisation ne semble pas s’améliorer.

technologie. Cette tendance à supposer que ces programmes sont aussi performants qu’on nous le dit n’est pas propre à l’IA – pensez aux « bombes intelligentes » – mais la tendance en matière d’utilisation ne semble pas s’améliorer.

Le mot « artificiel » dans l’IA est cependant exact. Ces programmes ne sont pas naturels, ce sont des artifices artificiels, conçus, créés et entretenus par des personnes. Permettre aux créateurs, ingénieurs et dirigeants d’échapper à la responsabilité de leurs décisions, simplement parce que nous imaginons que les grille-pain qu’ils ont fabriqués sont éveillés, ne fera que dégrader davantage Internet.

Je pense que 2026 sera le point le plus bas des médias sociaux. Sans changement, ces plateformes en ligne seront réduites à des formes plus horribles et plus désagréables sous la pression des maximalistes de l’IA, des mineurs de données extractives et des partisans fascistes d’un « clicktatorship » qui se soucient avant tout de créer et d’organiser des émissions de violence faites pour la télévision. Un meilleur Internet n’est cependant pas impossible. Nous pouvons nommer les personnes à l’origine de ces problèmes et nous pouvons faire quelque chose pour y remédier.

L’avertissement viral selon lequel « un ordinateur ne peut jamais être tenu pour responsable » issu d’un document de formation IBM de 1979 n’a jamais eu autant de résonance. Le problème avec Grok et d’autres programmes n’est pas qu’ils ont échappé au confinement comme Skynet, le problème s’apparente davantage à celui d’un propriétaire qui a laissé son chien agressif sans laisse.

Les gens qui vivent dans une société avec vous et moi utilisent ces outils à des fins malveillantes. Ce sont des gens qui prennent le temps dans leur journée de créer et de partager des images abusives d’enfants et d’étrangers, et qui se réjouissent de la douleur que ces images provoquent. Ce sont des gens qui publient des clichés d’eux-mêmes à côté d’émojis rieurs, désespérés d’être les plus drôles pour une fois. Ce sont des gens qui n’ont pas voulu retrouver leurs amis pour pouvoir rester éveillés tard dans la nuit pour programmer ces outils, qui se sont ennuyés et se sont concentrés sur de longues réunions pour discuter de l’implémentation de ce logiciel, et qui ignorent en ce moment les textes expliquant pourquoi ils laissent les plateformes dont ils sont responsables inonder de crasse.

Rien de tout cela n’est dû au grille-pain. Nous ne devrions pas permettre aux spécialistes du marketing et à leurs défenseurs de laisser ceux qui sont vraiment responsables éviter de se retrouver sous les projecteurs.